RAM: il problema che non esiste.

Come molti della mia generazione ho iniziato a usare i computer quando la RAM si misurava ancora in kilobyte, e per un bel pezzo il lusso erano i megabyte. I gigabyte sono arrivati relativamente tardi, quando ormai avevamo già visto e fatto di tutto con molto meno. E non erano affatto computer scadenti: ci si giocava, si faceva musica, si programmava, ci si collegava alle BBS, e ci tiravi fuori comunque una tonnellata di cose utili e divertenti. Non a caso esiste ancora gente che se li emula, per nostalgia ma anche per rispetto verso quella stagione di ingegneria sobria.

Perché parto da lì? Per dire che si poteva scrivere buon software — e persino buoni sistemi operativi — usando risorse che oggi definiremmo ridicole. Non è solo il solito esempio di Linux: BeOS, per dirne uno, venne messo in piedi in tempi brevissimi da un team minuscolo, lavorando in un ordine di grandezza di pochi megabyte, non di gigabyte. E poi c’è la battuta attribuita a Seymour Cray: gli raccontano che Apple ha comprato un Cray da milioni di dollari per progettare il nuovo Macintosh, e lui risponde che trova buffa la cosa, perché lui usa un Macintosh per progettare il nuovo Cray. Quella frase riassume benissimo un’epoca in cui si facevano cose serie con macchine che oggi considereremmo poco più che giocattoli.

È chiaro che qui voglio parlare di RAM, e del fatto che costa sempre di più, ma voglio farlo da un’altra angolazione: non da consumatore indignato perché il banco DDR5 è salito di prezzo, ma da uno che ha visto sistemi interi stare in piedi in meno memoria di quanta oggi spreca un singolo tab del browser.

Prima precisazione, così la togliamo subito dal tavolo: smettetela di dare la colpa alla AI. Il problema non è “l’intelligenza artificiale” in sé, e soprattutto non è la memoria che usano i nuovi chip per AI. Quella non è la stessa RAM che avete nel PC di casa o nel portatile da cui state leggendo queste righe, è un altro tipo di risorsa, con costi, vincoli e mercati diversi. Se mischiamo tutto nel calderone, non capiamo più dov’è davvero il collo di bottiglia.

Il motivo per cui i prezzi stanno salendo, oltre al collasso delle catene di fornitura globali innescato e aggravato dalle guerre di dazi e dai giochini di politica estera di Trump, è che la RAM ormai è dappertutto. Non è più solo “quel coso dentro al PC”: la trovate nelle auto, nei sistemi di infotainment e nelle centraline che fanno girare l’ADAS, nei televisori “smart”, nelle lavatrici e nei frigoriferi che parlano con il cloud, nei termostati, negli orologi da polso, negli auricolari, ovviamente in ogni singolo telefono, router, telecamera e scatoletta che osi definirsi “smart”.

E non è solo che la RAM è ovunque: è che in ognuno di questi oggetti la quantità di memoria sale di generazione in generazione, perché ogni iterazione è più “connessa”, più grafica, più “AI powered”, più piena di feature che nessuno disattiva mai. In auto passiamo da qualche decina di megabyte a diversi gigabyte per fare girare dashboard digitali e guida assistita; nei telefoni la norma sono ormai decine di gigabyte di RAM; persino un banalissimo televisore oggi monta più memoria di quanta ne avesse un server “serio” di vent’anni fa. Quando moltiplichi questo trend per centinaia di milioni di pezzi l’anno, il risultato è ovvio: la domanda di RAM esplode, l’offerta fatica a star dietro, e i prezzi iniziano a prendere il volo.

Possiamo chiuderla cosi', semplicemente decidendo che e' colpa del consumismo e della mania di comprare cose smart? No. Partiamo da una considerazione aneddotica. Fino a non molti anni fa, un router Wi‑Fi “decente” per casa aveva 32 o 64 MB di RAM, e 4–8 MB di flash per il firmware. Il grosso del lavoro lo facevano gli ASIC dedicati alla parte radio e al forwarding: il firmware, inciso in ROM o flash e di fatto immodificabile senza attrezzi da laboratorio, serviva solo a cambiare qualche parametro, impostare SSID e password, fare due regole di port forwarding e poco altro. Non c’era bisogno di molto di più, e infatti quei router stavano in piedi per anni.

Oggi, il mio router di casa – un TP‑Link da scaffale, niente di particolarmente “enterprise” – monta 1 GB di RAM, una quantità che fino a poco tempo fa vedevi solo su apparati di fascia alta o su router “gaming” tipo gli Archer AX di ultima generazione. Fa cose davvero così più sofisticate? In termini di bloat, sì: ha dentro un sistema operativo quasi general purpose, una GUI web piena di gadget, il supporto “user friendly” per VPN, VLAN, QoS “intelligente”, parental control, cloud management e ogni altra buzzword che il marketing sia riuscito a infilare in copertina.

Il punto è che tutte queste cose le fa MALE, dal punto di vista di chi sa davvero usare VLAN, VPN e compagnia, e soprattutto nessuno in casa ne sentiva il bisogno: per ottenere questo risultato mediocre siamo passati da 64 MB a 1 GB, solo per tenere in piedi un mostro di software generalista che dovrebbe far sentire “esperto di rete” anche chi non sa cos’è un indirizzo IP.

Del resto, se rovisto in qualche vecchia scatola in soffitta, probabilmente ci trovo ancora dei CD e dei floppy, magari anche i famosi super‑floppy da 120 MB o qualche cartuccia ZIP, con dentro immagini di installazione di Linux o di FreeBSD che all’epoca giravano tranquillamente con 16, 32 o 64 megabyte di RAM, ambiente grafico incluso. Non parlo di sistemi embedded esotici: parlo di distribuzioni general purpose, con X, un window manager leggero, un paio di applicazioni da ufficio come Staroffice e un browser dell’epoca, che in quelle risorse ci stavano davvero.

Provate oggi a prendere una distribuzione Linux “comoda” del 2005, buttarla in modalità solo terminale su un PC di dieci anni prima, diciamo un ferro del 1995 con poca RAM e un disco IDE lento, e poi ditemi come va. Scoprirete molto in fretta che non ce la fate: tra kernel più pesante, userspace cresciuto, toolchain moderna e assunzioni completamente diverse su quanta memoria “è ragionevole” avere, il sistema inizierà a swappare, rallentare, o semplicemente rifiutarsi di installarsi. La stessa classe di macchina che una volta faceva girare un Linux minimale o un FreeBSD in modo decoroso, oggi viene umiliata da software che, sulla carta, dovrebbe essere “solo” di una generazione successiva.

E certo, lo so già: adesso qualcuno tirerà fuori la miracolosa distribuzione “pico‑qualcosa” che sta su una chiavetta USB e sostiene di far resuscitare qualsiasi rottame. Siamo però su ordini di grandezza completamente diversi. La vostra umile chiavetta “poverella” oggi parte da 4–8 GB di spazio; nel 1995, su quella stessa macchina, io avevo un disco da 80 MB in totale e 4 MB di RAM, e con quello ci convivevo serenamente.

Qualche anno dopo, intorno al 1998, con 180 MB di disco e la bellezza di 8 MB di RAM ci giravo una Slackware completa, con fvwm come window manager, StarOffice installato, una stampante reale e una “fax” configurata, e tutto questo senza sentirmi un kamikaze delle risorse. Non era un esercizio di ascetismo informatico: era la normalità. Provate a chiedere alla vostra distribuzione “pico”, “micro” o “nano” da chiavetta di fare la stessa cosa, con la stessa parsimonia di RAM e di disco, e vediamo quanto dura l’eroismo. La verità è che nemmeno quella roba “super leggera” riesce più a fare, con pochi megabyte, quello che per noi era semplicemente un desktop di tutti i giorni.

NON ESISTONO CRISI DELL'HARDWARE. AVETE IN TASCA L'EQUIVALENTE DI UN MAINFRAME BANCARIO.

Cosa voglio dire con tutto questo amarcord sui floppy e sui megabyte? Che, complici la legge di Moore e soprattutto le sue interpretazioni più fantasiose da parte dell’industria, viviamo in una PERENNE CRISI DEL SOFTWARE. Non una crisi passeggera, ma uno stato patologico permanente in cui i programmatori – a meno che non facciano embedded o tempo reale duro – hanno disimparato a risparmiare risorse, e hanno smesso persino di porsi il problema. Un tempo su ogni scatola trovavi scritti i “requisiti minimi”; oggi il requisito minimo è “tutto quello che hai, ma un po’ di più”, tanto la RAM la compri, il disco costa poco, la CPU raddoppia ogni due anni e amen.

Non esiste una “crisi dell’hardware”: avete in tasca l’equivalente, per potenza bruta, di un mainframe bancario di qualche decennio fa, o di un supercomputer che all’epoca serviva a fare meteorologia e simulazioni aerospaziali. La differenza è che quel ferro, ai suoi tempi, faceva girare senza sgarrare un colpo i conti correnti di milioni di persone, chiudeva la giornata contabile di intere banche, macinava batch notturni senza sbagliare una somma. Oggi, su una macchina di potenza paragonabile che chiamiamo “cellulare”, il programmatore medio fatica a far girare un client di chat senza lag, senza battery drain e senza occupare mezzo gigabyte di RAM, e trova pure il modo di lamentarsi che “le risorse sono poche”.

STIAMO VIVENDO UNA CATASTROFICA CRISI DEL SOFTWARE

Il problema vero è che la stragrande maggioranza del software non serve a un cazzo di niente. Non fa nulla che non si potesse fare in modo più semplice, e soprattutto non viene usato da nessuno in modo significativo.

- Perché invece di scriversi venti righe di codice si tira dentro mezzo gigabyte di librerie e framework, spesso solo per avere un paio di funzioni che si potevano implementare in un pomeriggio.

- Perché si usano i cloud anche quando la memoria del cellulare sarebbe più che sufficiente a tenere dati e configurazioni in locale, senza latenza, senza abbonamenti e senza terze parti in mezzo.

- Perché si usano programmi che duplicano funzioni già presenti nell’hardware: c’è gente che installa HashiCorp Vault – pensato per gestire le credenziali di una nazione intera – per fare cose che il modulo crittografico di una smartcard potrebbe fare tranquillamente, e che infatti fa tranquillamente ogni volta che vi collegate in rete e vi autenticate con un AUC.

- Perché scrivere il firmware di una normale appliance domestica sembra impossibile senza infilarci sopra un sistema operativo multitasking completo, quando una semplice copia di FreeDOS, o comunque qualcosa di altrettanto minimale, sarebbe più che sufficiente per svolgere il lavoro richiesto.

- Perché l’abuso di macchine virtuali è diventato la norma, come se avessimo dimenticato l’esistenza di cose strane chiamate “compilatori statici” e “binari nativi”, e come se ogni processo dovesse vivere dentro tre strati di astrazione solo per principio.

- Perché l’abuso di orchestratori è ormai sistemico: non siete più capaci di tenere in piedi un sistema senza infilarci sopra un orchestratore tipo Kubernetes che “gestisca lo stack”, sotto ci mettete un altro orchestratore chiamato “cloud” per fare “hardware as a service”, e l’anno prossimo troverete sicuramente un nuovo orchestratore da incastrare da qualche parte, giusto per essere sicuri che nulla possa più essere compreso fino in fondo.

Penserete che io sia arrabbiato per la crisi della RAM. In realtà no. Anzi, spero che duri: altri vent’anni di RAM introvabile e storage venduto a peso d’oro sarebbero un’ottima cura dimagrante per un’industria che ha deciso che sprecare è normale.

Perché se il vostro laptop non diventerà mai davvero un supercomputer nel senso che avete in testa voi, anche se in pratica lo è già da anni e voi state solo sprecando ogni singola risorsa che ha, ma PRETENDETE comunque che “diventi di più”, allora c’è una sola soluzione. Quella che oggi non si può più dire ad alta voce.

E SE (RI)COMINCIASSIMO A SCRIVERE SOFTWARE MIGLIORE?

Questa crisi della RAM, come le crisi delle CPU e tutte le altre “emergenze” hardware cicliche, nasce da una scelta culturale precisa: il mondo dell’IT ha deciso che sprecare risorse è normale, quasi virtuoso, purché si arrivi in produzione in fretta e con abbastanza buzzword nel deck di slide. Se diventa normale buttare via cicli di CPU, gigabyte di RAM e terabyte di storage, è ovvio che ogni volta che qualcosa inceppa la supply chain la chiameremo “crisi dell’hardware”, invece di ammettere che abbiamo costruito un intero ecosistema sul presupposto che l’hardware sia infinito e praticamente gratis.

Questo atteggiamento ha ovviamente stimolato gli appetiti dei produttori di hardware, che non hanno alcun incentivo a lamentarsi: più software inefficiente c’è in giro, più core, più RAM e più storage si vendono, e ogni ondata di bloat si traduce in un nuovo giro di sostituzione forzata di PC, server, telefoni, router, appliance. In parallelo si è sviluppata un’industria del software che produce più librerie ridondanti, framework pesantissimi e stack “enterprise” di quanti use‑case reali riesca a soddisfare, con tutte le certificazioni, i badge e i curriculum gonfiati del caso, per cui nessuno ha interesse a protestare: se metti in discussione il bloat, metti in discussione anche metà delle linee su cui si regge il CV medio del settore.

State continuando a parlare di una crisi che, in realtà, non esiste nei termini in cui ve la raccontano. O meglio: una crisi c’è, ma non è “colpa della AI”, né, a essere sinceri, della proliferazione di elettronica “smart” messa ovunque. Il vero problema è che questa fame insaziabile di RAM, di storage, di GPU e di CPU nasce da un settore che ha deciso, culturalmente prima ancora che tecnicamente, che lo spreco di risorse è normale e professionalmente accettabile.

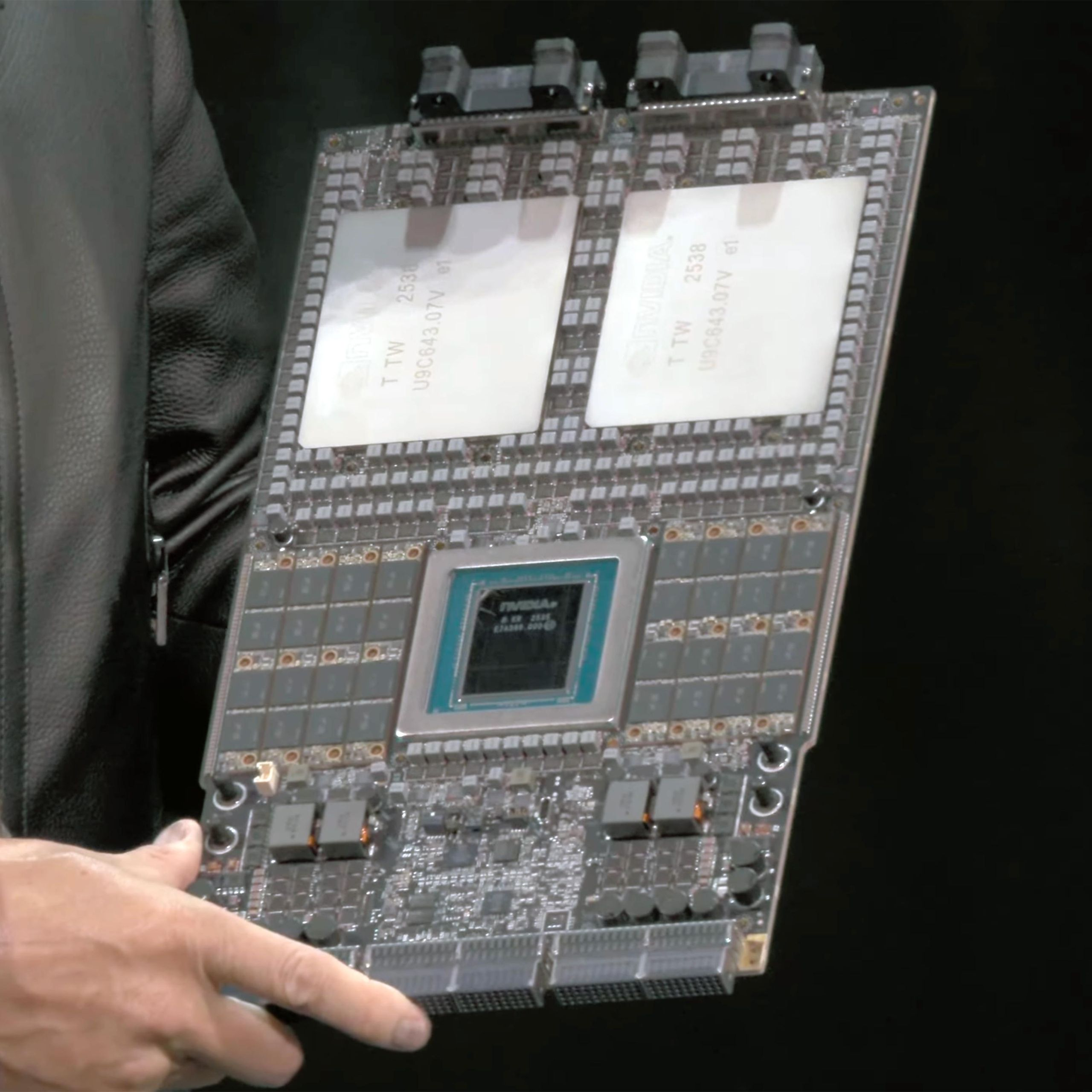

E a quanto pare la lezione non viene imparata. Arrivati alla fine pratica della legge di Moore, bloccati da limiti fisici banali come la dimensione del transistor e la dissipazione termica, la reazione non è stata “scriviamo software migliore”, ma “inventiamoci altra ferraglia”: così abbiamo schede video generaliste, GPU per il gaming, GPU “per AI”, NPU, TPU e ogni genere di acceleratore specializzato, in una corsa all’armamento che moltiplica ancora la montagna di merda sopra cui gira tutto. Il paradosso è che la stragrande maggioranza delle funzioni che oggi vendiamo come “AI” in azienda si potevano realizzare con una gestione decente dei processi e dei dati, e nell’informatica personale con sistemi esperti o comunque con automazioni vecchio stile, senza bisogno di trasformare ogni volta il data center in un allevamento intensivo di GPU.

Raggiunto il limite pratico delle CPU general purpose, si sono inventati che serviva un secondo processore potentissimo, dedicato, perché “l’AI non gira sul vostro computer” e quindi bisogna affiancargli una GPU, una NPU, una qualunque sigla nuova che giustifichi altro silicio. Alla fine, però, buona parte di quello che oggi spacciamo per necessità di acceleratori “esterni” si sarebbe potuto ottenere semplicemente scrivendo software migliore, sia in azienda che nel mondo consumer.

E se oggi vi dicono che avete bisogno di Copilot per aiutarvi con Office, è solo perché Office stesso è diventato nel tempo un blob inutilizzabile, ridondante, pieno di funzioni che nessuno usa e di complessità che nessuno controlla più: serve un’AI per farvi da badante dentro un’applicazione che, se fosse stata progettata con buon senso, non avrebbe mai richiesto una guida turistica integrata per scrivere due pagine di testo e una tabella.

Dove porta questo trend? Quali porcherie infileranno dentro i vostri computer di casa.

Buona parte di quello che oggi vedete finire nei vostri PC di casa viene prima provato nei data center, ammortizzato sulle “grandi istallazioni”, e poi ribaltato in modalità backport sul mercato consumer per pagarsi i costi di sviluppo. Se volete sapere quali porcherie vi infileranno nel laptop di casa, basta guardare cosa gira oggi nelle server farm.

- Le SmartNIC, per esempio. Oggi la vostra scheda di rete fa fondamentalmente Ethernet II, un subset base di funzionalità e poco altro. Le SmartNIC di data center, invece, fanno offload di mezzo stack di rete, SAN comprese, parlano RDMA, NVMe‑oF e possono essere programmate in P4 per instradare, filtrare, cifrare e fare firewalling direttamente sulla scheda. Domani ve le ritroverete nei PC di casa, vendute come rivoluzione per il gaming e per lo “streaming pro”, con il piccolo dettaglio che per sfruttarle davvero bisognerà cablare in fibra non solo il tratto fino a casa, ma tutta la casa: basta rame, solo fibra, nuovo router con porte ottiche, nuovo cablaggio di appartamento, nuovo business completamente inutile per l’uso reale che fate di internet. Vi sembrera' troppo, ma ve lo venderanno come "scheda di rete con il firewall dentro".

- Poi arriverà il turno dei Media Processor audio. Nel grande pimp‑up del silicio, le schede sonore per ora se le fila poca gente, ma la fantasia non manca: sostituire una semplice scheda audio con un processore “intelligente” in grado di fare in hardware tutto quello che oggi fa un DJ set professionale, mastering live, effetti in tempo reale, spatial audio, magari pure un sintetizzatore con sampling integrato. Nessuno di voi ne sente il bisogno per guardare Netflix o fare una call su Teams, ma vuoi mettere la figata di poter fare un rave party usando solo il laptop e vantarsi dell’uscita audio in fibra placcata oro “per gli audiofili”? È così che si crea domanda artificiale: aggiungendo complessità che nessuno ha chiesto. Vi sembrera' troppo, ma poi, i Content Creator, e Onlyfans si impenna.

- Sul fronte rete wireless, la situazione è già grottesca: arrivate a casa con una FTTH a 2 Gbit, ma il telefono, nella realtà fisica, viaggia sui soliti 200–300 Mbit di banda effettiva, quando va bene, perché Wi‑Fi, distanze, muri e interferenze non leggono le brochure del provider. Il collo di bottiglia è evidente, quindi la prossima idea “geniale” sarà infilare una femtocella 6G dentro ogni router domestico: prendiamo il successore del 5G, lo miniaturizziamo, lo mettiamo nel salotto e vi promettiamo il gigabit reale sul telefono, a patto ovviamente di vivere dentro un microonde a onde millimetriche per il resto della vostra vita condominiale. Congelate pure gli ovuli. Altrimenti avrete figli dalle manine bellissime. Tutte e sette.

E questo è solo l’inizio. La fantasia sul fronte interfacce utente farà il resto: magari, siccome tastiera e mouse “sono roba vecchia”, vi venderanno touch da 26 pollici da usare come leggio, penna capacitiva in mano, gesti ampi, calligrafia riscoperta, il tutto per tornare a scrivere come ai tempi della penna stilografica, ma con quattro strati di software, una GPU saturata dal rendering dell’ink e un altro mezzo gigabyte di framework solo per disegnare una lettera sullo schermo

Il cielo e' il loro limite.

Il portafogli e' il vostro.

Tutto il resto si chiama "crisi".